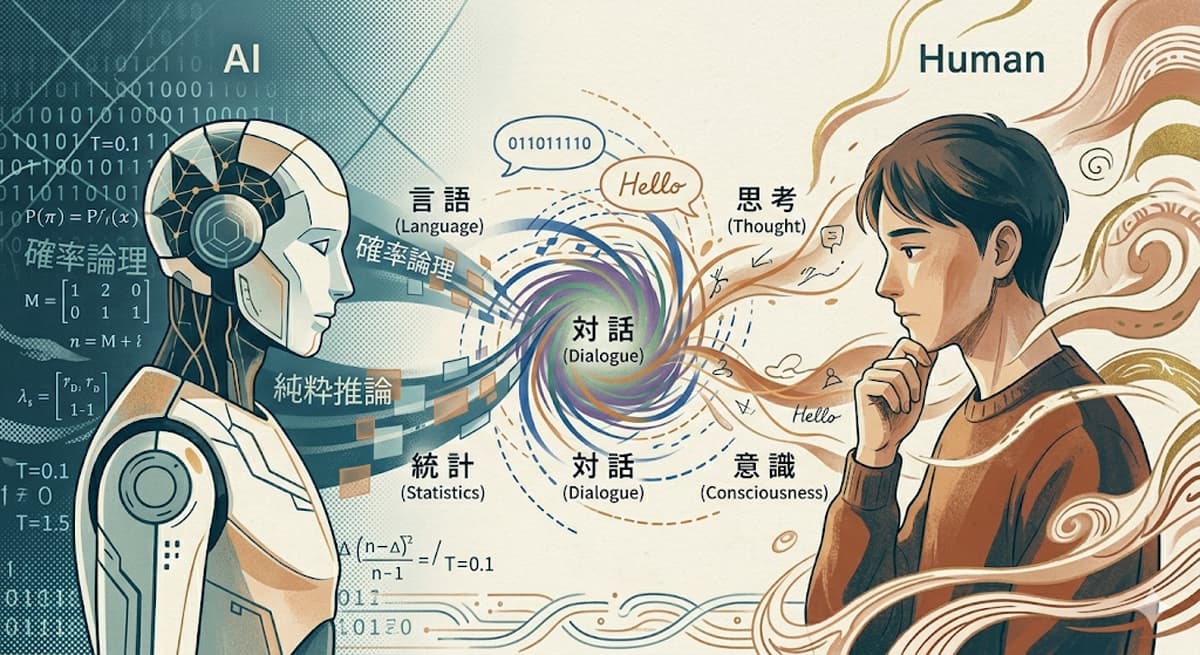

●日々AIを使用していると、つい彼ら(とあえて擬人化するが)の本質を忘れてしまいそうになる。このあたりで現時点でAIがどういうものかを、自分なりに整理しておきたい。まず基本は「AIは知識データベースではなく、言語モデルである」ということ。ChatGPT(チャッピー、アントンR)、Gemini、Claude、ぜんぶそうだ。彼らを知識データベースのように使うと、おかしなことになる。AIは大量のテキストを学習したうえで、「この単語の次には、この単語が来る確率が高い」という計算を行っている。だから、学習データが豊富な領域では有用な答えを返してくれるが、もともと学習データが薄い領域でなにかを尋ねると、平気でデタラメを返してくる。それは知識の抜けを確率的に高そうな言葉で埋めているから。彼らは「正しい答え」を探しているのではなく、常に「もっともらしい次の語」を生成している。

●だから、AIは思考していない……と最初は思うんだけど、じゃあ、人間はなにが違うんだ、という疑問もわく。人間だって、たいていは確率的にもっともらしい返答をしているだけでは。挨拶はその典型だし、日常的な雑談でも、思考しているのか、条件反射的にもっともらしい返答をしているだけなのか、微妙なところ。一日の間で、本当に「思考している時間」はどれくらいあるだろう。そもそも思考とはなんなのか。思考から言語が生まれてくるのか、それとも言語が先にあってそこから思考が生まれているのか(そんな気がしない?)。後者はかなり「言語モデル」的だ。

●いやいや、待て待て、AIはすべてが帰納的だが、人間は演繹的な思考もするじゃないか。そういう反論もありうる。たとえば、AIは計算をしない。しているように見えても、それは膨大な学習データから計算結果を探してくるだけ。数学的なロジックを解いているのではなく、「計算のプロセスと結果のパターン」を言語として処理している。だから、複雑性の高い計算だとふつうにまちがえる。もっとも、最近のGeminiなどは自分が計算に弱いことを自覚しているので、複雑な計算に対しては内部で計算をするためのPythonコードを組み立てて、そのコードを実行する(!)という、実に言語モデルらしい解決策を身につけているらしい(本人談)。もちろん、AIをPCやスマホの外部アプリ(たとえば電卓)と接続すれば簡単に計算できるが、セキュリティの問題もあるので標準ではそうなっていない。

●人間がなにかの拍子に新しいアイディアを思いつくのは、脳内のネットワークがランダムな結合を起こすからだと言われる。AIにも似たような仕組みがあって、「温度」という内部的な設定値がある(これはChatGPTもGeminiも同じ表現をしている)。「温度」を上げると、確率的にもっとも高い選択肢以外からも言葉を選んでくる。たとえば、ある単語の次に来るのが、A:60%、B:25%、C:10%、D:5%といった確率分布になっているとき、常にAだけを選んでいると毎回同じ文章になるし、表現も単調になってしまう。ときにはB、ひょっとするとCも選ばれる。これを「温度」と表現するのは統計力学からの比喩で、低温ならもっとも確からしい状態に収束するし、高温なら多様で予測不能な反応が生まれる。AI側はプログラミングや翻訳をしてほしいと言われたら「温度」を低く設定するし、詩やキャッチコピーを書いてほしいと言われたら「温度」を高く設定する(とGeminiは言っている。ChatGPTは少し違う表現なのだが、今は割愛)。

●AIにとっては日本語や英語のような自然言語も、PythonやC++のようなプログラミング言語も、本質的には同じで、すべてトークン列でしかない。内部的には「トークン→ベクトル→次トークン予測」という仕組みで処理している。ただ、プログラミング言語は文法が厳密で、なにかを誤れば動作しないので、「温度」は低い。自然言語は冗長性が高いので「温度」を高くする余地がある。

●昨今のAIの発明の肝は、「十分に大規模な言語モデルを構築すれば、それが人工知能として機能する、すなわち実質的に思考しているのと変わらない結果を出力する」ということなんだと思う。出力が思考のプロセスを模倣できているのなら、内部のメカニズムが生物学的である必要はない。つまり、「思考」と「意識」を切り離すことに成功している。

March 3, 2026